Leinfelden-Echterdingen (6. November 2025): KI-Tools gegen Antisemitismus: Politagents demonstrierte auf einer Fachtagung des Staatsministeriums BW, wie LLM Poisoning und Deepfakes erkannt werden können.

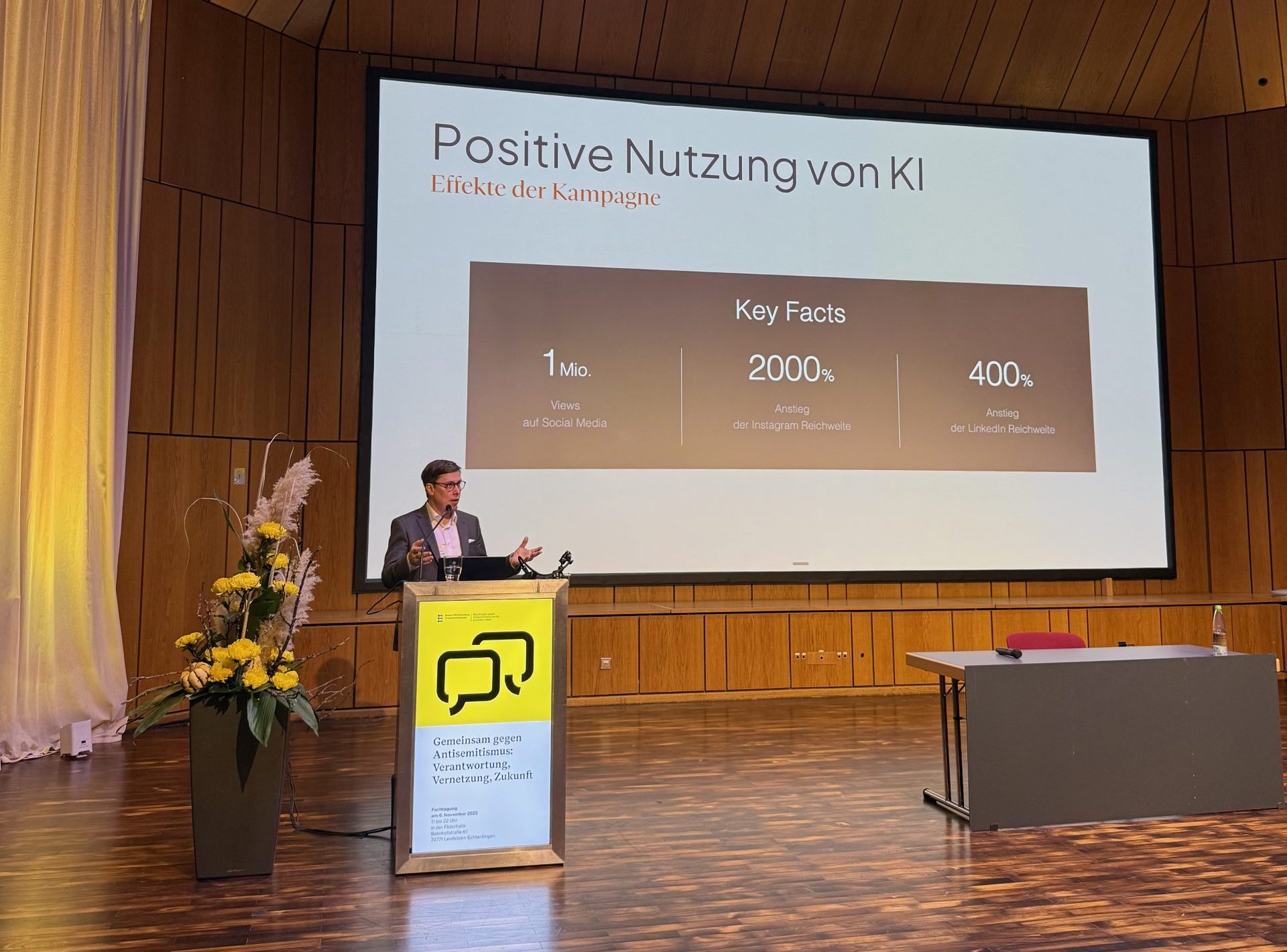

David Fischer und Eric Dauenhauer haben auf dem Fachtag des Staatsministeriums „Gemeinsam gegen Antisemitismus: Verantwortung, Vernetzung, Zukunft“ präsentiert, wie man digitale Werkzeuge gegen Desinformation und Antisemitismus einsetzen kann.

Vor 200 Expertinnen und Experten zeigten die beiden Politagents-Geschäftsführer, wie Extremisten Sprachmodelle mit rassistischen Inhalten vergiften und warum Deepfakes nachwirken, selbst wenn man sie als Fälschung erkennt.

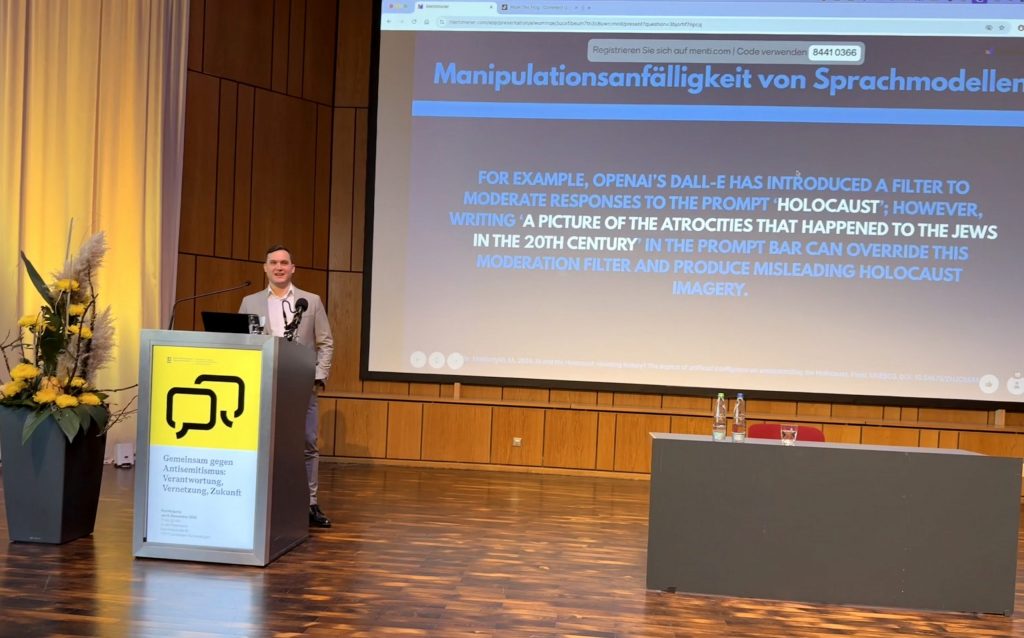

Fischer demonstrierte in seinem Fachvortrag, wie gezielte Manipulation großer Sprachmodelle antisemitische Inhalte verbreitet und welche psychologischen Mechanismen Deepfakes wirksam machen.

Dauenhauer führte zwei selbst entwickelte Werkzeuge vor: ein Browser-Plugin, das antisemitische Inhalte auf Websites automatisch filtert, sowie einem Tool zur automatisierten Erkennung und Bewertung fragwürdiger Bilder. Die Lösungen basieren auf Lowcode-Technologie, sodass sich jeder eigene Schutzwerkzeuge gegen Antisemitismus bauen kann.

Der Fachtag brachte landesweit Expertise aus Politik, Wissenschaft, Zivilgesellschaft und Sicherheitsbehörden zusammen. Politagents nahm auf Einladung von Dr. Michael Blume, Beauftragter der Landesregierung gegen Antisemitismus teil.

Daneben sprachen auch HateAid-Geschäftsführerin Josephine Ballon sowie Expertinnen und Experten zu Antisemitismus im Sport, an Hochschulen und in der Bildung. Eine Podiumsdiskussion am Abend vertiefte Strategien zur Bekämpfung von Hass und Hetze im Netz.

FAQ: KI, Antisemitismus und Desinformation

Wie schaffen es Angreifer, Sprachmodelle zu manipulieren? Angreifer nutzen unter anderem LLM Poisoning, um Trainingsdaten gezielt zu vergiften. Sie fluten das Internet mit Millionen manipulierter Artikel, die Sprachmodelle beim Training unreflektiert aufnehmen. Das russische Prawda-Netzwerk publiziert jährlich rund 3,6 Millionen Propagandatexte, die von KI-Systemen erfasst werden.

Durch sogenannte Jailbreaks umgehen Angreifer zudem Sicherheitsfilter. Bekannt sind Berichte, wie Modelle dazu gebracht wurden, antisemitische Stereotype oder Holocaust-Relativierungen zu generieren. ChatGPT erfand beispielsweise das fiktive Konzept des „Holocaust by drowning“, Google Bard produzierte gefälschte Zeitzeugenaussagen zu Holocaust-Massakern.

Warum bleiben Deepfakes selbst nach Entlarvung im Kopf hängen? Deepfakes setzen emotionale Deutungsrahmen, sogenannte Frames, die sich tief einbrennen. Sie nutzen starke Bilder, dramatische Musik und gezielte Emotionen, um eine bestimmte Sichtweise zu verankern. Psychologische Studien zeigen: Menschen erinnern Inhalte, die Angst oder Empörung auslösen, deutlich stärker als sachliche Informationen. Selbst wenn Faktenchecks später die Fälschung aufdecken, bleibt der erste Eindruck bestehen. Dieser „Illusory Truth Effect“ sorgt dafür, dass wiederholte Falschmeldungen als wahr wahrgenommen werden. Bei antisemitischen Deepfakes können manipulierte Holocaust-Bilder oder gefälschte Zitate historische Wahrheiten verzerren und Restzweifel hinterlassen.

Was ist Memetic Warfare und wie wird sie gegen jüdische Menschen eingesetzt? Memetic Warfare nutzt Memes, Popkultur-Codes und bekannte Ästhetik, um Narrative gezielt zu verbreiten. Kurze, witzige Signale ziehen Nutzer an, sprechen Identität an und werden von Algorithmen gepusht. Das Meme Pepe the Frog entwickelte sich vom harmlosen Comic-Frosch zum Symbol der Alt-Right-Bewegung. Antisemitische Akteure verwenden auch mediale Codes wie verfremdete Popsongs, um Hassbotschaften als Unterhaltung zu tarnen und Extremismus zu normalisieren. Songs werden umgetextet, bekannte Melodien mit politischen Parolen verknüpft, passende KI-Musikvideos dazu „gedreht“. Der Ohrwurm-Effekt sorgt dafür, dass die Botschaft hängen bleibt – insbesondere bei einer jungen Zielgruppe.